ENSONHABER’İ TWİTTER’DA TAKİP EDEBİLİRSİNİZ

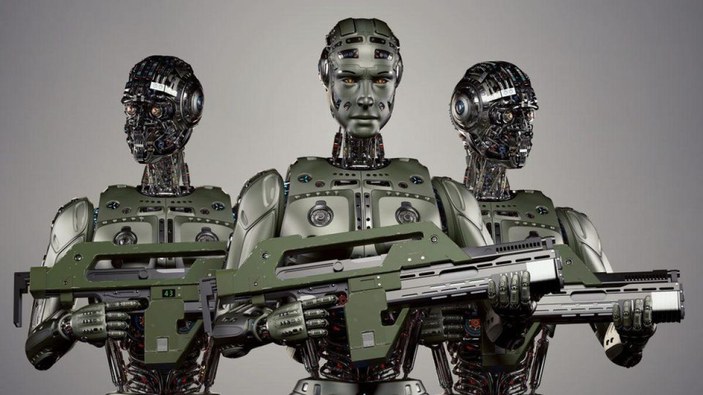

Günümüzde teknolojik ilerlemeler, yapay zekanın savaş alanlarındaki rolünü giderek artırmaya başladı..

Yapay zekanın askeri uygulamaları, gelecekteki savaşlara yön vermek ve modern savaş stratejilerini dönüştürmek için etkileyici bir güç olarak ortaya çıkıyor.

Yapay zekanın savunma ve saldırı yeteneklerinin geliştirilmesi, ülkelerin askeri güç projeksiyonunu ve askeri üstünlüğü sağlama kapasitesini kökten değiştirme potansiyeline sahip.

Ordularda, yapay zeka teknolojisi için dört ana uygulama alanı vardır: lojistik, keşif, siber uzay ve savaş.

İlk üç alanda, gelişmiş yapay zeka uygulamaları halihazırda kullanımda veya test ediliyor. Yapay zeka, lojistik zincirlerini optimize etmeye, gerekli bakımı tahmin etmeye, yazılımdaki güvenlik açıklarını bulmaya ve çok büyük miktarda veriyi birleştirmeye yardımcı oluyor.

Yapay zeka, bu nedenle şimdiden askeri operasyonlar üzerinde bir etkiye sahip. Ancak savaşın kendisini hala esas olarak insanlar yönetiyor. Peki ya gelecekte?

Savaşların seyri değişiyor

Dünyanın dört bir yanındaki çatışma bölgelerinde artan sayıda uzaktan kumandalı insansız hava araçları, yapay zeka destekli savaşların habercisi.

2009 ile 2017 arasında, savaşan Amerikan askerlerinin sayısı yüzde 90 azaldı ve ABD insansız hava aracı saldırılarının sayısı on kat arttı.

Bugün ABD, Rusya, İsrail, Çin ve İran insansız hava araçları Orta Doğu, Afrika kıtası, Güneydoğu Asya ve Avrupa’da saldırılar düzenliyor.

Otonom olarak hedeflerini belirleyen ve onlara saldıran tamamen otonom dronlar, bir BM raporuna göre çoktan konuşlandırılmış olabilirler.

Bu tür sistemler, ölümcül otonom silah sistemlerine bir örnektir. Bunları ağır bir şekilde düzenlemek veya tamamen yasaklamak için uluslararası çabalar var.

Bununla birlikte, bir savaşı başlatabilecekleri veya bozabilecekleri için, özellikle büyük askeri güçler onları yasaklama konusunda isteksizdir.

Savaşta üçüncü devrim

Otonom silahlar, atom bombası ve barutun icadından sonra savaştaki üçüncü devrim olarak kabul edilir. Çünkü güç dengesini değiştirmek için aynı yeteneğe sahipler.

Eski bir asker, ABD Savunma Bakanlığı danışmanı ve “Otonom Silahlar ve Geleceğin Geleceği” kitabının yazarı Paul Scharre, silah sistemlerinde gelişmiş yapay zeka teknolojisinin kullanılmasından vazgeçmenin, elektrik ve içten yanmalı motorlardan vazgeçmeye benzer olduğunu söylüyor.

Savaşta yapay zeka: Üç aşamada silah sistemleri

Tüm otonom silah sistemleri, distopik katil robotlar değildir. Silah sistemlerinin özerkliği kabaca üç seviyeye ayrılabilir:

Yarı özerk silah sistemleri,

İnsan denetimli otonom silah sistemleri,

Tamamen otonom silah sistemleri.

Yarı özerk silah sistemlerine bir örnek, bir insan tarafından ateşlendikten sonra önceden belirlenmiş bir hedefe bağımsız olarak saldıran füzelerdir. Bu, pilotların art arda birden fazla hedefe saldırmasına olanak tanır. Füzeler, dünya çapındaki ordular tarafından hava ve yer hedeflerine saldırmak için kullanılıyor.

İnsan denetimli otonom silah sistemleri, doğası gereği daha savunmacı olmuştur ve insan tepki süresinin savaşın hızına ayak uyduramadığı her yerde kullanılır.

Bir insan tarafından etkinleştirildikten sonra, hedeflere bağımsız olarak saldırırlar – ancak sürekli insan denetimi altında olmaları gerekir..

Örnekler arasında donanma gemilerinde kullanılan ve etkinleştirildikten sonra füzelere, helikopterlere ve uçaklara bağımsız olarak saldıran Aegis savaş sistemi veya Patriot ve Demir Kubbe füze savunma sistemleri sayılabilir. 30’dan fazla ülkenin bu tür sistemleri zaten kullandığı biliniyor.

Ancak bu, “gezgin cephaneler” adı verilen yeni bir silah sınıfının geliştirilmesiyle değişti. Bu insansız hava araçları, otonom yeteneklere sahiptir ve belirli hedeflere saldırmak için bir insan tarafından programlanmıştır. Bu saldırı insan tarafından durdurulabilir. Savaş uçaklarını veya helikopterleri riske atmadan birliklere hava desteği sağlayabilirler.

Bu tür dronlar, denetimli ve tamamen otonom silah sistemleri arasındaki çizgiyi bulanıklaştırıyor ve en az on yıldır kullanılıyor.

Otonom savaş makinelerinin durumu

Bugüne kadar hiçbir ordu resmi olarak tamamen otonom silah sistemlerini kullanmadı. Tamamen otonom bir savaş, (henüz) yapay zeka destekli savaşın yalnızca bir distopyasıdır.

Teknik açıdan bakıldığında, bu tür sistemlerin henüz geniş çapta konuşlandırılmamasının bir ana nedeni var: Gerekli yapay zeka teknolojisi henüz mevcut değil.

Son on yılda makine öğrenimindeki patlama, yapay zeka araştırmalarında sayısız ilerleme sağladı, ancak mevcut yapay zeka sistemleri profesyonel askeri kullanım için uygun değil.

Teorik olarak hassasiyet, güvenilirlik ve yüksek hızlı yanıt vaat ediyorlar. Ancak pratikte, gerçek dünyanın karmaşıklığı nedeniyle hala başarısız oluyorlar.

Mevcut yapay zeka sistemleri genellikle bağlamı anlamıyor, değişen koşullarla güvenilir bir şekilde başa çıkamıyor, saldırılara karşı savunmasız ve kesinlikle etik ölüm kalım kararları vermeye uygun değil.

Aynı nedenlerle, büyük yatırımlara ve büyük vaatlere rağmen, otonom arabalar hâlâ yollarımızda yaygın olarak kullanılmıyor.

NATO ve ABD otonom silah sistemlerinin geliştirilmesi ve konuşlandırılmasını desteklediklerini ifade ederken, denetimli otonom silah sistemlerinin ötesine geçmek istemiyorlar. Çünkü yapay zekanın güvenilirliği için hala insanların kontrolünde olması gerekiyor.

ABD ordusunun araştırma kolu DARPA, ilgili gelişmelere milyarlarca dolar fon sağlıyor.

Ama kontrol tam olarak nedir? Çizginin tam olarak nerede çekildiği her zaman net değildir – bir insanın daha sonra kendi kendine öldüren bir silah sistemi başlatması yeterli midir? Tekrar kapatabilmesi gerekiyor mu? Peki ya insanın karar verme hızının artık yeterli olmadığı durumlar?

Havada insan-makine iş birliği

Şu anda, askeri ve savunma müteahhitlerinin odak noktası, öncelikle çeşitli sensör verilerini birleştirmek ve insanlarla iş birliği yapan sistemler geliştirmek.

Eski JAIC başkanı Nan Mulchandani, 2020’de ABD ordusunun odak noktasının ortak savaşta bilişsel yardım olduğunu söyledi.

Bu sistemlerden bazıları uçmak, sürmek veya dalmak, istihbarat toplamak, belirlenen hedeflere kendi başlarına saldırmak veya erzak sağlamak için tasarlanmıştır. Ancak görevlerini, hedeflerini ve izinlerini her zaman bir insandan alırlar.

Örneğin ABD Hava Kuvvetleri, Skyborg Programının bir parçası olarak Kratos’un XQ-58A varyantlarını test etti. Ancak gizli insansız hava araçlarının, bir insan pilotun yanında uçması, ondan emirler alması ve destekleyici bir keşif ve silah platformu sağlaması gerekiyor.

Program 2021’den beri test ediliyor ve bir düzine kadar insansız hava aracının yakın zamanda faaliyete geçmesi bekleniyor.

Öte yandan, ABD Donanması, MQ-25A Stingray insansız hava aracını temel alan otonom tanker uçağı geliştiriyor. Boeing ayrıca bir Loyal Wingman drone geliştirdi ve bunu Avustralya Hava Kuvvetlerine (RUAF) satıyor.

Rus Hava Kuvvetleri ise daha büyük S-70 Okhotnik insansız hava aracına, Çin Hava Kuvvetleri ise FH-97A’ya güveniyor .

Suda ve karada insansız hava araçları

Dronların ayrıca suda insanlara yardım etmesi bekleniyor: Örnekler arasında ABD Donanması destroyeri Sea Hunter, Boeing’in Orca denizaltısı ve Rus donanmasına saldıran basit Ukraynalı drone botları gibi yarı otonom gemiler yer alıyor.

Savunma müteahhitleri, karada kullanılmak üzere, ABD Ordusu tanklarına eşlik etmek için tasarlanmış Ripsaw M5 savaş uçağı ve Suriye’de halihazırda kullanılmış olan Rus Uranium-9 tankı gibi çeşitli silahlar geliştiriyorlar.

ABD piyadeleri, termal görüntüleme kameralarına sahip küçük keşif uçaklarıyla çalışıyor ve ABD Hava Kuvvetleri, Ghost Robotics’in yarı otonom robotik köpeğini test ediyor.

Alçaktan ve düşük maliyetli keşif hala insan gözüyle yapılıyor, ancak Ukraynalı bir insansız hava aracı komutanına göre, Ukrayna mevcut görüntülerle kendi yapay zekasını eğitiyor.

Bu, insansız hava araçlarının Rus askerlerini ve araçlarını otomatik olarak tespit etmesine ve GYKH döngüsünü önemli ölçüde hızlandırmasına (Gözlemle, Yönlendir, Karar Ver, Harekete Geç) olanak tanıyor.

Siber uzayda yapay zeka ve gelecekteki çatışmalar

Yapay zeka, gerçek dünyadaki savaştan uzakta, siber uzayda giderek daha fazla kullanılıyor.

Orada, kötü amaçlı yazılımların algılanmasına veya kritik altyapı üzerindeki siber saldırılardaki kalıpların belirlenmesine yardımcı olabiliyor.

2022’nin sonlarında NATO yapay zekayı siber savunma için test etti: Altı ekip, hayali bir askeri üste bilgisayar sistemleri ve elektrik şebekeleri kurmak ve simüle edilmiş bir siber saldırı sırasında bunları çalışır durumda tutmakla görevlendirildi.

Ekiplerden üçüne ABD Enerji Bakanlığı’nın Argonne Ulusal Laboratuvarı tarafından geliştirilen Otonom İstihbarat Siber Savunma Ajanı’nın (AICA) prototipine erişim sağlandı.

Deneyi yöneten siber güvenlik uzmanı Benjamin Blakely’ye göre test, AICA’nın saldırı modelleri, ağ trafiği ve hedef sistemler arasındaki ilişkileri daha iyi anlayıp korumaya yardımcı olduğunu gösterdi.

Sonuç

Siber güvenlik, bilişsel yardım, sensör füzyonu veya silahlı robotik köpekler olsun, yapay zeka şimdiden savaş alanını değiştiriyor.

Robotik, dünya modeli geliştirme veya yapay zeka destekli malzeme bilimi ve üretim tekniklerindeki gelişmeler yeni silah sistemlerini mümkün kıldıkça, etkiler önümüzdeki yıllarda artacaktır.

Yasalar da muhtemelen bu geleceğin bir parçası olacak, en azından “Ölümcül Otonom Silah Sistemleri Alanında Gelişen Teknolojilere İlişkin İlkeler ve İyi Uygulamalar” başlıklı bir düzenleme şimdiden önerildi.

Söz konusu düzenleme, Mart 2022’de Avustralya, Kanada, Japonya, Kore Cumhuriyeti, Birleşik Krallık ve Amerika Birleşik Devletleri tarafından BM’ye sunuldu.